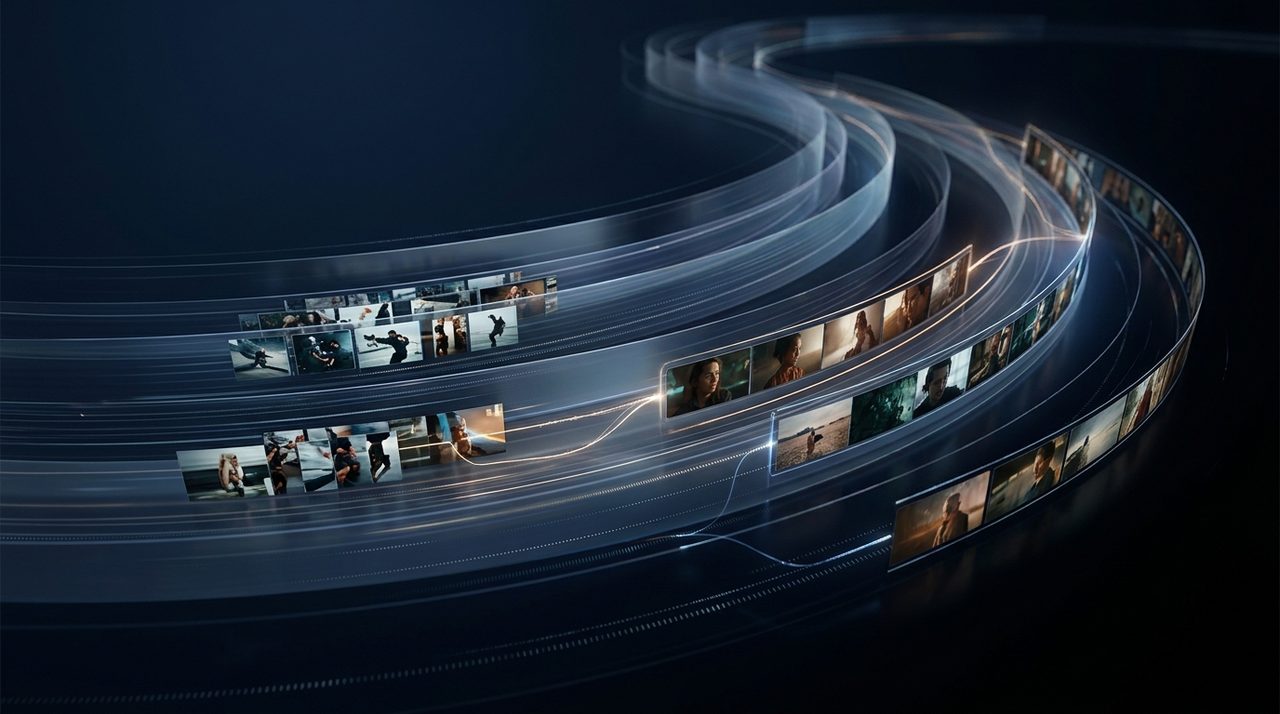

Filmemacher und Studios

Scenario: Regie bei Multi-Shot-Narrativszenen mit komplexen menschlichen Interaktionen.

Outcome: Erreicht filmisches Storytelling mit präziser, realitätsnaher Physik, konsistenten Charakteren und bildgenauer Kontrolle über Kamerabewegungen.